Kecerdasan buatan (AI) menghasilkan kembar realistis yang berlebihan untuk politisi, selebriti dan pornografi, dan banyak lagi – meninggalkan para korban teknologi Deepfake yang berjuang untuk menentukan suaka legal.

Eric Cole, mantan pakar keamanan dunia maya, mengatakan kepada CIA, Dr. Eric Cole Fox News, bahwa praktik privasi yang lemah di internet dan kesediaan orang untuk mempublikasikan informasi mereka secara publik di media sosial membuat mereka rentan terhadap deepfake intelijen buatan.

“Kucing itu sudah berada di luar tas,” katanya.

“Mereka memiliki foto -foto kita, dan mereka mengenal anak -anak kita, dan mereka tahu keluarga kita. Mereka tahu di mana kita tinggal. Sekarang, dengan kecerdasan buatan, mereka dapat mengambil semua data ini tentang siapa kita, apa yang kita lihat, apa yang kita lakukan, bagaimana kita berperilaku, dan mereka terutama dapat membuat kembar digital.”

Pertimbangkan tips ini untuk menghindari penipuan oleh Deepfake yang telah dibuat dari kecerdasan buatan

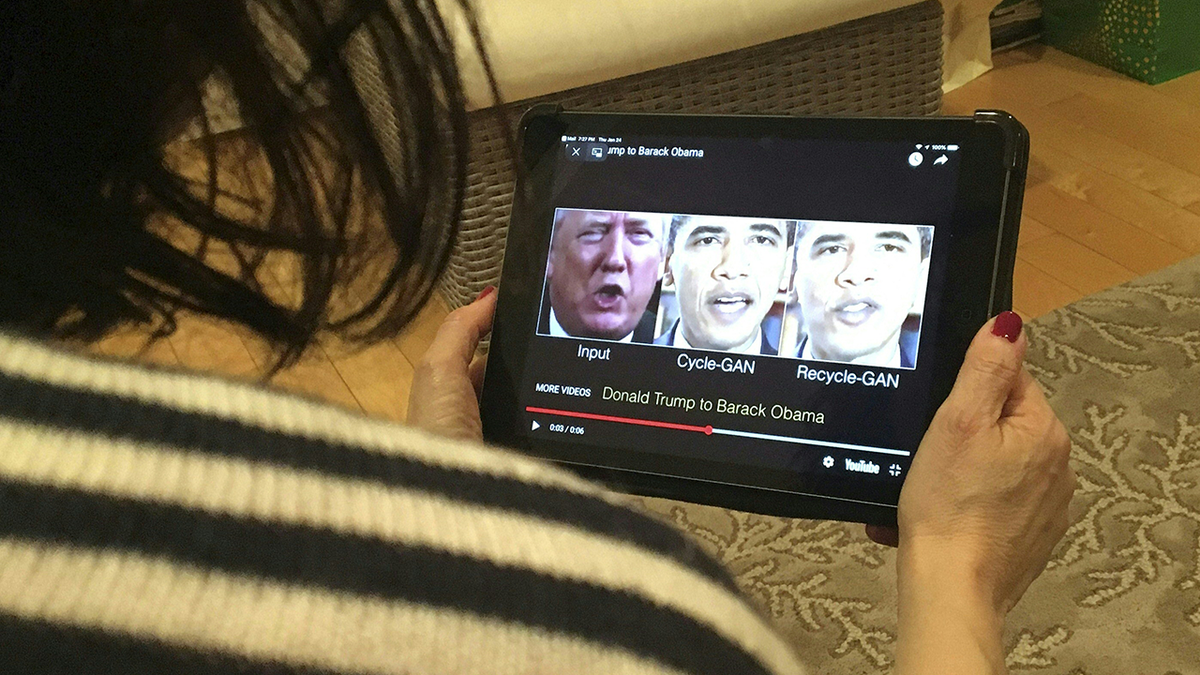

AI, yang dikenal sebagai “Deepfake”, sering menyertakan klip video atau gambar orang agar mereka terlihat seperti orang lain atau menggunakan suara mereka untuk memberikan data yang telah diucapkan dalam kenyataan. (Elyse Samuels/The Washington Post/Lane Turner/The Boston Globe/Stefani Reynolds/AFP via Getty Images)

Dia mengklaim bahwa kembar digital begitu baik sehingga sulit untuk mengetahui perbedaan antara versi buatan dan orang sungguhan yang diandalkan oleh Deepfake.

Bulan lalu, klip audio penipuan Donald Trump Junior didistribusikan, menunjukkan bahwa Amerika Serikat seharusnya mengirim peralatan militer ke Rusia alih -alih Ukraina.

Pamflet Ini telah banyak dibahas di media sosial dan tampaknya merupakan klip dari episode podcast “Dia tumbuh dengan Donald Trump Junior.”

Para ahli dalam analisis digital kemudian mengkonfirmasi bahwa perekaman suara Trump Junior dibuat menggunakan kecerdasan buatan, mencatat bahwa teknologi telah menjadi lebih “efisien dan berkembang”.

FactPostNews, dan Akun resmi Partai Demokrat, Menyebarkan suara seolah -olah otentik. Akun kemudian hapus pendaftaran. Novel lain, Partai Republik melawan Trump, juga menerbitkan klip itu.

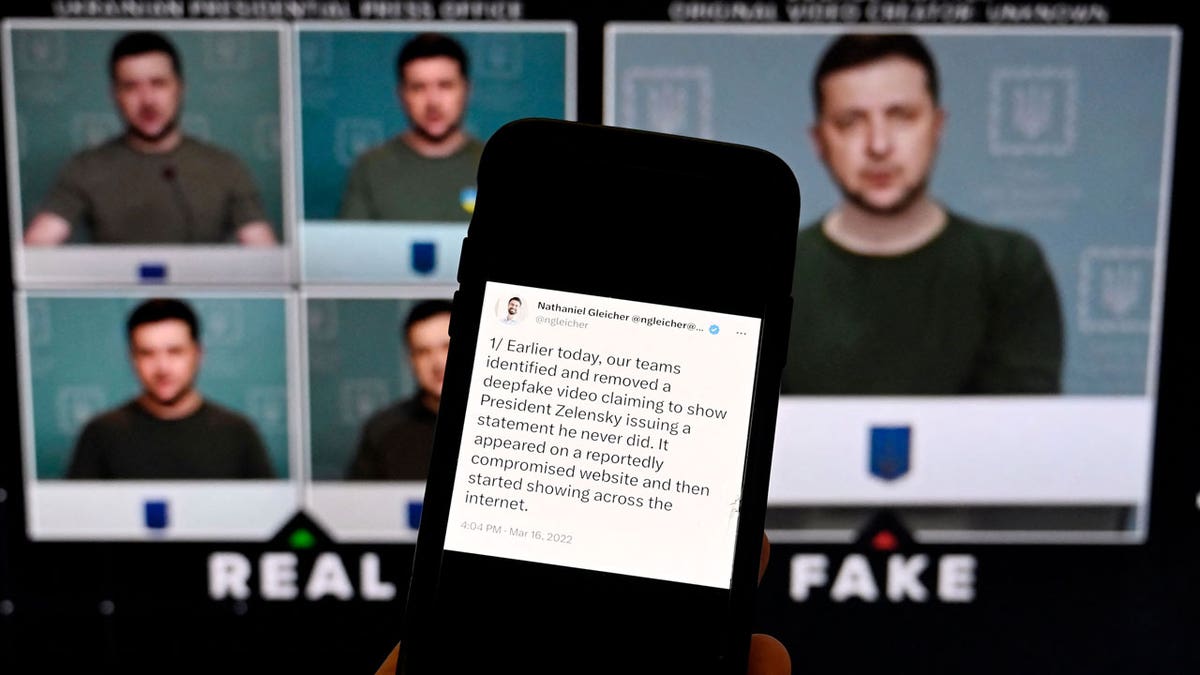

Dalam beberapa tahun terakhir, banyak contoh kecerdasan mendalam telah digunakan untuk menyesatkan pemirsa yang berpartisipasi dalam konten politik. Sebuah video tahun 2022 menunjukkan apa yang tampaknya menjadi presiden Ukraina Folodimir Zelinski menyerah kepada Rusia – tetapi klip palsu itu buruk dan menyebar hanya untuk periode internet saja.

Video yang ditujukan kepada Presiden Donald Trump dan mantan Presiden Joe Biden kemudian muncul pada periode sebelum pemilihan presiden AS 2024.

Porno yang dibuat dari kecerdasan buatan, termasuk palsu, selebriti, berlanjut di Etsy sebagai hukum Deepfake “tertunda”

Seorang wanita di Washington, DC, melihat video yang dimanipulasi pada 24 Januari 2019, yang mengubah apa yang dikatakan Presiden Donald Trump dan mantan Presiden Barack Obama, menjelaskan bagaimana teknologi Deepfake telah berkembang. (Sungai Robar /AFP via Getty Images)

AI, yang dikenal sebagai “Deepfake”, sering menyertakan klip video atau gambar orang untuk membuatnya terlihat seperti orang lain yang menggunakan kecerdasan buatan. Deepfakes mencapai radar penonton pada tahun 2017 setelah pengguna Reddit menerbitkan penampilan realistis selebriti ke platform, dan membuka gerbang banjir kepada pengguna yang menggunakan kecerdasan buatan untuk membuat gambar terlihat lebih meyakinkan dan menghasilkan partisipasi mereka lebih luas di tahun -tahun berikutnya.

Beri tahu Cole Fox News Digital bahwa orang -orang adalah “musuh terburuk” mereka sehubungan dengan AI Deepfakes, dan mengurangi paparan online mungkin merupakan cara terbaik untuk menghindari menjadi korban.

Namun, dalam politik dan media, di mana “visi adalah kuncinya”, tokoh -tokoh publik menjadi tujuan utama untuk penggunaan kecerdasan buatan yang keji. Perwakilan ancaman yang tertarik pada pengulangan Presiden Trump akan memiliki banyak umpan untuk membuat data dan data kembar digital untuk pemimpin Amerika di berbagai tempat.

Kongres harus menghentikan alat AI baru yang digunakan untuk mengeksploitasi anak -anak

“Semakin tinggi jumlah video yang bisa saya dapatkan, bagaimana dia berjalan, bagaimana dia berbicara, dan bagaimana dia berperilaku, saya bisa memberi makan ini dalam model kecerdasan buatan dan saya dapat membuat realistis yang mendalam seperti Presiden Trump. Di sinilah segalanya benar -benar menakutkan.”

Selain mengambil tanggung jawab pribadi dari waktu data pribadi secara online, Cole mengatakan bahwa undang -undang tersebut mungkin merupakan cara lain untuk mengurangi penggunaan Amnesty International yang tidak tepat.

Sens disajikan. Ted Cruz, R-Texas, dan Amy Klobuchar, D-Minn, Take It Download, yang akan menjadikannya kejahatan penerbitan federal, atau ancaman untuk menyebarkan gambar intim yang tidak biasa, termasuk “pemalsuan digital” yang terbuat dari kecerdasan buatan. Draf undang -undang dengan suara bulat menyetujui Senat pada awal tahun 2025, ketika Cruz mengatakan pada awal Maret bahwa ia percaya akan disahkan oleh Dewan Perwakilan Rakyat sebelum undang -undang tersebut.

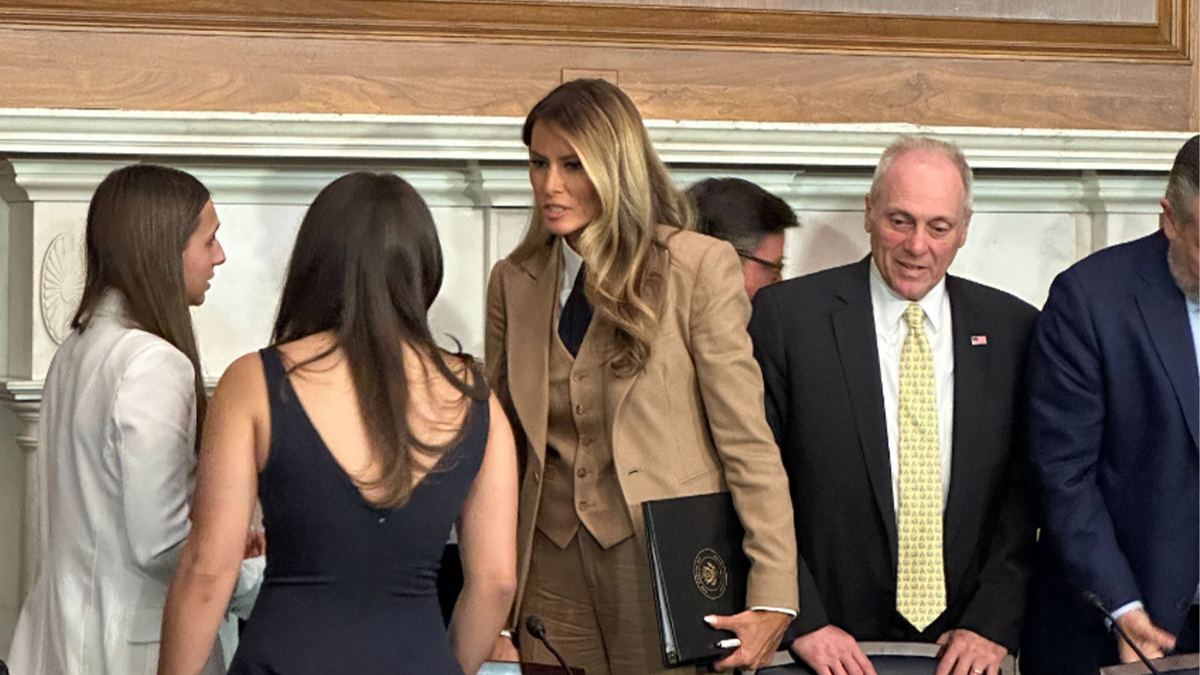

Ibu Negara Melania Trump melakukan perjalanan ke Capitol Hill pada hari Senin untuk sebuah meja bundar untuk memobilisasi dukungan undang -undang unduhan Take It. (Fox News)

Undang-undang yang diusulkan akan membutuhkan hukuman hingga tiga tahun penjara karena berbagi gambar intim intim-otentik atau kecerdasan buatan yang mencakup istana dan penjara dua tahun untuk foto-foto yang termasuk orang dewasa. Ini juga akan membutuhkan hukuman hingga dua setengah tahun penjara karena kejahatan ancaman yang terlibat dalam anak di bawah umur, dan satu setengah tahun penjara dalam ancaman yang terlibat pada orang dewasa.

Draf undang -undang juga akan mewajibkan perusahaan media sosial seperti Snapchat, Tiktok, Instagram dan platform serupa untuk mengembangkan prosedur untuk menghapus konten ini dalam waktu 48 jam setelah pemberitahuan dari korban.

Siswa sekolah menengah, orang tua memperingatkan agar tidak mengancam foto telanjang Deepfake

Ibu Negara Melania Trump berbicara tentang Capitol Hill awal bulan ini untuk pertama kalinya sejak dia kembali ke Gedung Putih, dan berpartisipasi dalam meja bundar dengan legislator, korban balas dendam porno dan Deepfake yang dihasilkan oleh kecerdasan buatan.

“Saya di sini bersama Anda hari ini dengan tujuan bersama – untuk melindungi masa muda kita dari bahaya melalui internet. Keberadaan memiliki berbagai perilaku kasar di bidang digital pada kehidupan sehari -hari anak -anak kita, keluarga kita dan masyarakat kita,” kata Melania Trump pada 3 Maret.

Dan Andy Lukassio, co -founder dan arsitek Eternos.Life (dikaitkan dengan konstruksi kembar digital pertama). Ini menunjukkan bahwa banyak industri AI Deepfake disajikan dari situs yang tidak tunduk pada hukum Amerika, dan undang -undang tersebut dapat mempengaruhi sebagian kecil situs web.

Pakar keamanan nasional Paul Charry melihat sebuah video yang telah dimanipulasi oleh BuzzFeed dengan sutradara Jordan Pele (R di layar) menggunakan program dan aplikasi yang mudah tersedia untuk mengubah apa yang dikatakan mantan Presiden Barack Obama (L di layar), menjelaskan bagaimana teknologi Deepfake dapat menipu pemirsa, di kantornya di Washington, DC, 25 Januari 2019. (Sungai Robar/AFP via Getty Images)

Dia juga menunjukkan bahwa teknik kloning teks untuk berbicara sekarang dapat menciptakan “palsu sempurna”. Sementara sebagian besar penyedia layanan utama memiliki kontrol penting untuk mencegah penciptaan palsu, saya mengatakan kepada Locascio Fox News Digital bahwa beberapa penyedia layanan komersial mudah ditipu.

Selain itu, Locascio mengatakan bahwa siapa pun yang memiliki akses yang masuk akal ke unit prosesor grafis yang kuat (GPU) dapat membangun model audio mereka sendiri yang mampu mendukung “hewan kloning”. Beberapa layanan yang tersedia membutuhkan kurang dari 60 detik suara untuk menghasilkan ini. Klip ini kemudian dapat diedit menggunakan program dasar untuk membuatnya lebih meyakinkan.

Senator Demokrat yang ditargetkan oleh kepribadian pribadi Dipvik dari pejabat Ukraina dalam pembesaran panggilan: Laporan

“Model yang terkait dengan realisme suara dan video telah berubah. Sekarang, semua orang harus berasumsi bahwa apa yang mereka lihat dan dengar adalah palsu sampai terbukti bahwa itu otentik,” katanya kepada Fox News Digital.

Meskipun ada sedikit panduan kriminal tentang Deepfake, pengacara Danny Karon mengatakan bahwa dugaan korban masih dapat mengikuti klaim sipil dan mendapatkan kompensasi untuk uang.

Dalam buku berikutnya, “Panduan Pengacara Pengacara untuk Kesehatan Hukum: Berjuang Melawan Dunia Super Penipuan Anda,” kata Karen bahwa AI Deepfakes termasuk dalam undang -undang pencemaran nama baik tradisional, khususnya pencemaran nama baik, yang mencakup menerbitkan pernyataan yang salah melalui literatur (menulis, gambar, suara, dan video).

Gambar ilustrasi ini, yang diambil pada 30 Januari 2023, menunjukkan layar telepon yang menampilkan pernyataan dari kepala kebijakan keselamatan meta dengan video palsu (saw) dari presiden Ukraina Folodimir Zelinski mengundang tentaranya untuk menampilkan senjata mereka di latar belakang, di Washington, DC, (Olivier Douliery/AFP via Getty Images)

Untuk membuktikan pencemaran nama baik, penggugat harus memberikan bukti dan argumen tentang elemen -elemen tertentu yang memenuhi definisi hukum pencemaran nama baik sesuai dengan hukum negara. Banyak negara memiliki kriteria yang sama untuk membuktikan pencemaran nama baik.

Misalnya, di bawah hukum Virginia, seperti halnya dalam persidangan DEEB melawan Deeb Against Herd, tim aktor Johnny Depp harus memenuhi elemen -elemen berikut yang mencemari:

- Terdakwa membuat atau dipublikasikan

- Pernyataan itu tentang penggugat

- Pernyataan itu memiliki definisi jaksa penuntut

- Efek memfitnah dirancang dan dirancang oleh terdakwa

- Karena keadaan di sekitar publikasi, ia dapat merangkul efek memfitnah dari seseorang yang melihatnya

“Anda tidak dapat menyimpulkan bahwa ada sesuatu yang memfitnah sampai Anda tahu apa itu dan pencemaran nama baik.

Caron Fox News Digitter mengatakan kepada Deepfake dengan invasi hukum privasi, hukum pelanggaran, pengejaran sipil, dan hak propaganda.

Hakim Federal melarang undang -undang California, yang melarang pemilihan mendalam

Citra realistis yang berlebihan dari Bros Willis sebenarnya adalah dalam yang diciptakan oleh perusahaan Rusia yang menggunakan jaringan saraf buatan. (Deepcake via Reuters)

Dia berkata: “Jika Tom Hanks baru -baru ini memilih suaranya untuk mempromosikan rencana gigi, ini adalah contoh dari perusahaan yang mengambil keuntungan dari nama, citra dan rupa seseorang, dan dalam hal ini suara, untuk menjual produk, untuk mempromosikan atau mengekstrak iklan dari orang lain. Anda tidak dapat melakukan itu.”

Sayangnya, masalah dapat muncul jika penggugat tidak dapat menentukan siapa yang menciptakan Deepfake atau jika pelaku hadir di negara lain. Dalam konteks ini, seseorang yang berharap untuk mengejar masalah pencemaran nama baik mungkin dipaksa untuk mempekerjakan pakar web untuk menemukan sumber konten.

Jika individu atau entitas bersifat internasional, ini menjadi masalah tempat. Bahkan jika seseorang ditemukan, penggugat harus menentukan jawaban dari pertanyaan -pertanyaan ini:

- Bisakah seseorang disajikan?

- Akankah negara asing membantu memfasilitasi ini?

- Akankah terdakwa tampaknya diadili?

- Apakah penggugat memiliki kemungkinan yang masuk akal untuk mengumpulkan uang?

Jika jawaban untuk beberapa pertanyaan ini adalah tidak, itu mungkin bukan investasi waktu dan sumber daya keuangan yang diperlukan untuk mengikuti klaim ini sepadan.

“Hak -hak kami hanya efektif seperti kemampuan kami untuk menerapkannya, seperti paten. Orang -orang berkata,” Saya memiliki paten, jadi saya dilindungi. “Tidak, Anda tidak.

Klik di sini untuk mendapatkan aplikasi Fox News

Fox News Brock Singman dan Emma Colon berkontribusi pada laporan ini.